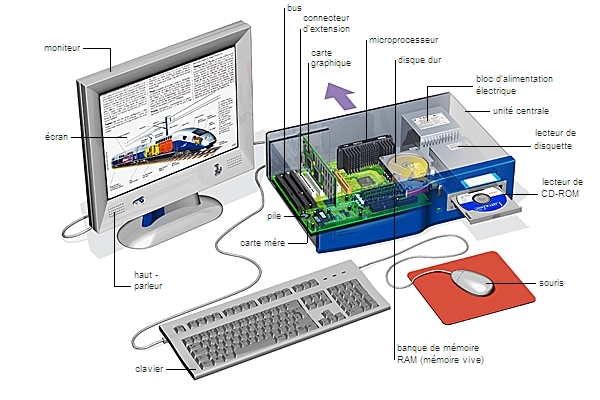

micro-ordinateur

Petit ordinateur construit autour d'un microprocesseur auquel on adjoint l'environnement logiciel et matériel (écran, clavier, lecteur de CD/DVD), nécessaire au traitement complet de l'information.

Physiquement, un micro-ordinateur se présente le plus souvent comme un boîtier électronique de dimensions réduites formant l'unité centrale, connecté à un écran de visualisation (moniteur), à un clavier alphanumérique et à une « souris ».

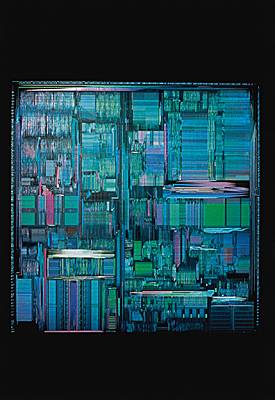

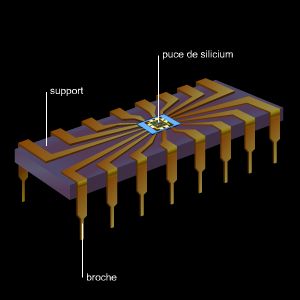

L'unité centrale du micro-ordinateur est organisée autour d'un microprocesseur, organe de traitement des informations avec des instructions de format de plus en plus long : 8, 16, 32 et maintenant 64 bits ; d'une horloge qui cadence l'exécution des instructions avec une vitesse de plus en plus rapide : aujourd'hui plusieurs gigahertz ; d'une mémoire centrale à semi-conducteurs dont la capacité ne cesse d'augmenter et se compte à présent en gigaoctets. Aujourd’hui, les processeurs « multicœurs » regroupent sur un circuit intégré unique plusieurs microprocesseurs interconnectés. Cette architecture permet d’accroître la puissance tout en réduisant l’échauffement et la consommation électrique. Un élément essentiel est la mémoire auxiliaire. Celle-ci peut comprendre un disque dur qui mémorise de façon non volatile les informations traitées ; sa capacité se compte fréquemment en centaines de gigaoctets.

Les clés USB, que l’on connecte à l’ordinateur sur les ports du même nom, ont supplanté les disquettes comme supports de mémoire amovibles externes. Leur capacité peut atteindre plusieurs gigaoctets.

Parmi les périphériques classiques, l'imprimante permet de sortir sur papier les informations traitées. Le développement des technologies de communication sans fil simplifie la communication entre le micro-ordinateur et d’autres ordinateurs ou périphériques.

La connexion d'un ensemble de micro-ordinateurs implantés en un même site, pour constituer un réseau local, permet de reculer les limites de ces machines et de les employer comme instruments de communication entre leurs utilisateurs.

Historique et évolution

La paternité du premier micro-ordinateur est contestée. Mais de nombreux observateurs s'accordent à reconnaître le Micral (conçu par François Gernelle) de la société française R2E comme la première machine du genre à avoir été commercialisée, en 1973. Celui-ci était bâti sur le premier microprocesseur capable de traiter huit informations binaires simultanément (8 bits), le 8008 de la firme américaine Intel. Il possédait une mémoire centrale de 256 octets, que l'on pouvait étendre à 2 kilo-octets. Il a fallu cependant attendre la naissance de l'Apple I, en 1975, pour que ces ordinateurs à l'usage d'un seul utilisateur commencent à ne plus être seulement considérés comme de curieux prototypes. Conçu par Steve Wozniak et Steve Jobs, fondateurs de la firme Apple Inc., l'Apple I a connu, à partir de 1976, un certain succès commercial auprès des particuliers, des étudiants, voire des développeurs de programmes. Mais c'est IBM, le premier fournisseur mondial du marché informatique, qui a donné au micro-ordinateur ses lettres de noblesse, en lançant, en 1981, l'IBM PC.

Depuis lors, les micro-ordinateurs ont connu un extraordinaire développement. Leur coût a sensiblement diminué tandis que leurs performances ne cessent de croître. Cette évolution est liée au progrès des techniques de conception et de fabrication des circuits intégrés et des disques magnétiques. Les microprocesseurs sont de plus en plus rapides et les composants de mémoire ont une capacité de stockage de plus en plus étendue.

Les nouvelles technologies favorisent, par ailleurs, l’essor de micro-ordinateurs portables de plus en plus légers et qui consomment de moins en moins d’énergie, grâce à l’utilisation de mémoire flash ou de disques durs sans pièce mécanique mobile.

Applications

Les toutes premières applications des micro-ordinateurs étaient plutôt simplistes : jeux, traitement de textes, petits calculs. Pour qu'une machine soit capable de traiter un grand nombre d'informations ou d'effectuer des opérations complexes, il faut non seulement que son microprocesseur soit puissant, mais aussi que sa mémoire centrale soit importante. Au fur et à mesure que les micro-ordinateurs ont vu progresser ces deux caractéristiques, les applications qu'ils ont pu traiter sont devenues de plus en plus complexes. C'est grâce au logiciel VisiCalc, commercialisé en 1979 par la société américaine Software Art, que le micro-ordinateur Apple II a commencé à séduire de nombreux utilisateurs. Ce « tableur » a séduit les managers parce qu'ils permettait d'effectuer des calculs sur des rangées de nombres et remplaçait donc avantageusement calculette et hypothèses comptables effectuées « à la main ». Il a montré, de plus, que la micro-informatique n'était pas seulement un phénomène réservé à des applications domestiques et ludiques, mais bel et bien un outil à l'usage de professionnels, gage d'une productivité accrue.

Les tableurs représentent une grosse partie des logiciels pour micro-ordinateurs. Ils ont évolué et sont devenus, pour certains, de véritables outils d'aide à la décision, en permettant de réaliser des modèles financiers ou comptables et d'en simuler les résultats, tout en étant dotés de fonctions de traitement de textes et de graphiques (histogrammes, camemberts…). Le traitement de textes, lui aussi, représente une grosse partie des applications de la micro-informatique. En offrant des fonctions toujours plus sophistiquées, telles que correction orthographique, affichage et impression de multiples polices de caractères, gestion automatique des coupures de mots en fin de ligne… Mieux : il est désormais possible de mettre en page des documents à l'écran, grâce aux logiciels de mise en page. La publication assistée par ordinateur (ou P.A.O.), encore appelée microédition, permet ainsi de réaliser propositions commerciales, lettres confidentielles, voire livres, revues et journaux, sans passer par un photocompositeur. De plus en plus prisé des professionnels des arts graphiques, qui ont en outre à leur disposition des logiciels de dessin, le micro-ordinateur a trouvé là un nouveau marché. La conception assistée par ordinateur (C.A.O.), du simple « grapheur » au logiciel de conception architecturale en trois dimensions, fait, elle aussi, une percée de plus en plus importante auprès des utilisateurs. Sans compter, bien sûr, toutes les applications plus « classiques » de type gestion de fichiers et de bases de données, comptabilité, facturation, paie, prospection commerciale…

Convivialité et simplicité

Un néophyte, moyennant une formation minimale, peut se servir d’un logiciel même s’il ne connaît rien à la programmation, ni même au fonctionnement de son ordinateur. Les premiers micro-ordinateurs n’étaient pas pour autant d’une grande simplicité d’utilisation. L’« interface utilisateur » mise en œuvre obligeait l’utilisateur à mémoriser de nombreuses commandes et à effectuer de sérieuses acrobaties sur le clavier. Le Macintosh d’Apple, commercialisé à partir de 1984, a montré que l’on pouvait concilier informatique et convivialité. Pour la première fois, tout est graphique : les fichiers de données et certaines commandes sont représentés sous forme de petits dessins (« icônes ») qu’il suffit à l’utilisateur de désigner au moyen d’un curseur piloté par une petite boîte munie d’un bouton (« souris ») pour y accéder. D’autres commandes apparaissent en clair en haut de l’écran, sous forme de listes (« menus ») et l’on peut également les désigner à l’aide de la souris. L’interface graphique du Macintosh, fortement inspirée des travaux effectués au Palo Alto Research Center de la société Xerox, a fait depuis de nombreux émules. La généralisation des interfaces graphiques a contribué à faciliter l’emploi de logiciels de plus en plus puissants : cette mutation a rejailli sur tous les usages de l’informatique.

Les réseaux et le modèle client-serveur

Grâce à des moyens matériels (câbles, boîtiers de communication…) et logiciels constituant un réseau, il est possible de faire échanger des informations entre des ordinateurs et des périphériques. Il arrive de plus en plus fréquemment que le traitement d’une application se partage entre un micro-ordinateur appelé client et une machine beaucoup plus puissante dite serveur, de façon à tirer parti de leurs capacités respectives. La machine cliente effectue des traitements préparatoires et formule, à travers l’interface dont elle dispose, des requêtes qu’elle adresse ensuite au serveur qui se charge des traitements et renvoie les résultats. Cette organisation convient en particulier pour les grosses bases de données gérées de façon centralisée et auxquelles accèdent simultanément de nombreux utilisateurs grâce à des réseaux (réservation de billets de train ou d’avion, gestion de comptes bancaires, etc.). À mesure que le nombre des micro-ordinateurs utilisés dans les entreprises croît et que les tâches que ces machines sont capables d’effectuer deviennent de plus en plus complexes, les réseaux se multiplient et donnent à la micro-informatique une nouvelle dimension : de personnelle, celle-ci devient communicante.